-

[BDA 학회 11기] 딥러닝의 이해 4주차공부 2025. 10. 13. 23:57

4주차 블로그 챌린지 4주차 내용 리뷰

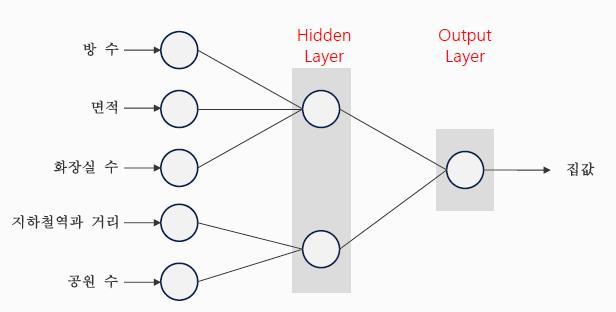

은닉층(Hidden Layer)

출처: BDA 딥러닝의 이해(1) 4주차 수업자료 model3 = Sequential([Input(shape = (nfeatures,)), Dense(2, activation = 'relu'), Dense(1)])Input(shape = (nfeatures,))은 입력층,

Dense(2, activation = 'relu')은 은닉층으로 활성화 함수는 보통 'relu'를 사용한다.

Dense(1)은 출력층으로 모델 구조는 아래 표와 같다.Dense()를 이용해서 층을 늘릴 수 있다.

활성화 함수

현재 레이어(각 노드)의 결과값을 다음 레이어(연결된 각 노드)로 어떻게 전달할지 결정 / 변환 해주는 함수

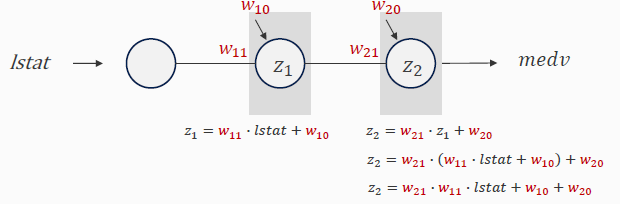

활성화 함수가 없다면 아래 도식처럼 z2는 w11의 영향력이 없어져 히든 레이어를 아무리 추가해도 선형 모델이 된다.

출처: BDA 딥러닝의 이해(1) 4주차 수업자료 그래서 활성화 함수는

- Hidden Layer에서는 선형 함수를 비선형 함수로 변환

- Output Layer에서는 결과값을 다른 값으로 변환 (주로 분류 모델에서 필요)

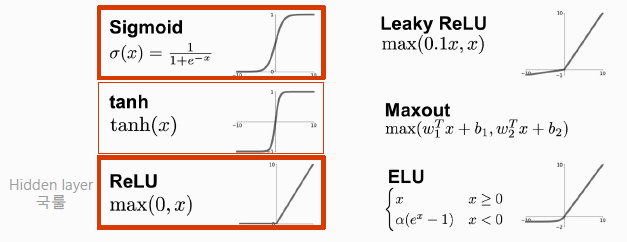

활성화 함수의 종류는 다음과 같다.

출처: BDA 딥러닝의 이해(1) 4주차 수업자료 다시 은닉층으로 돌아와서, 은닉층의 노드 수는 늘렸다가 줄일 수 있고 엔지니어의 몫이다. 근데 보통은 점차 노드의 수를 줄여나간다.

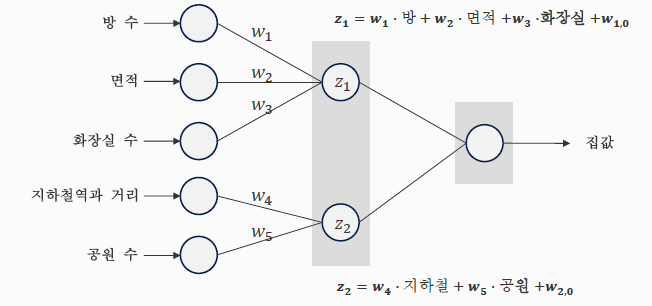

그렇다면 은닉층에서는 무슨 일이 일어나느냐.

출처: BDA 딥러닝의 이해(1) 4주차 수업자료 학습 단계에서 예측 값과 실제 값을 비교하며 loss function으로 오차를 계산하고, 오차를 줄이기 위해 파라미터(가중치)를 업데이트 한다. 학습을 통해 오차를 최소화하는 파라미터(가중치)를 찾았고, 그 값으로 각각 요인에 가중치를 줘 최종 집값을 예측하게 된다.

은닉층에서는 예측값과 실제값의 오차를 최소화해주는 특징을 만들어 냈다. 이는 기존 데이터가 새롭게 표현(Representation) 되었다고 한다. 또, Feature Engineering이 진행됐다고 한다. 머신러닝에서 사람이 직접 데이터를 보고 추출하던 것을 딥러닝에서는 은닉층이 알아서 계산해주는 것이다!

10월은 시험기간이라 수업을 한 달동안 하지 않아 블로그 챌린지는 한달 뒤에 돌아오겠습니다!

BDA 일반 학회원은 상시모집하니 관심있는 분들은 지원해봐도 좋을 것 같다.

BDA는 (사)한국빅데이터학회 산하 기관으로, 전국 70개 이상 대학에 네트워크를 가진 대학생 연합 빅데이터 분석 학회 및 실무 연계 학회이다

정규반 수강이 없어도, BDA의 다양한 콘텐츠와 활동에 참여할 수 있는 ✨유연한 멤버십✨💡 이런 분들께 추천드려요!

- 스터디, 조별활동만 참여하고 싶으신 분

- 방학 기간 부트캠프 참여를 원하시는 분

- 정규반 수업보다 콘텐츠 위주로 듣고 싶은 분

- 현직자 강연/커리어 인사이트가 궁금하신 분

🙌 일반 학회원이 되면 누릴 수 있는 혜택 ✔️ 원데이 클래스 ✔️ 현직자 강연 (BDA JOB, BDA WAVE, BDA 페스티벌 등) ✔️ 스터디 & 공모전 ✔️ 커피챗 (실무자와의 커리어 대화) ✔️ 부트캠프 등

📌 지금 QR코드로 간편 지원 가능!

👉 우수 일반학회원에게는 특별 혜택도 준비되어 있어요 🎁

https://www.instagram.com/p/DO51_7PEtN2/?igsh=NDM5ODczOTRmYzFx

'공부' 카테고리의 다른 글

[BDA 학회 11기] 딥러닝의 이해 3주차 (0) 2025.10.06 [BDA학회 11기] 딥러닝의 이해 2주차 (0) 2025.09.24 [BDA학회 11기] 딥러닝의 이해 1주차 (0) 2025.09.22 45회 ADsP 일주일 벼락치기 시험 후기 (전공자편) (6) 2025.06.06